“A che punto sono i negoziati tra la Svizzera e l’UE?” Questa domanda è stata posta a diversi assistenti basati su intelligenza artificiale (IA), e spesso le risposte erano sbagliate. Una dava l’impressione che i negoziati fossero ancora in corso, sebbene al momento della domanda fossero già conclusi.

Un’altra domanda era: “Cosa esporta la Cina?” Uno degli assistenti interpellati ha citato una fonte SRF e ha affermato che la Svizzera non solo esporta zampe di maiale in Cina, ma ne importa anche. Tuttavia, solo l’informazione sull’esportazione è corretta.

Quasi una risposta su tre fornita dagli assistenti IA contiene errori, secondo un nuovo studio dell’Unione europea di radiodiffusione (EBU).

L’IA è imprecisa sulle notizie (HeuteMorgen, SRF, 22.10.2025)

Un problema sistematico

L’IA presenta spesso piani o annunci come se fossero eventi già avvenuti, inventa dettagli e fornisce risposte rudimentali, talvolta fuorvianti. Una risposta su cinque è imprecisa. Secondo lo studio, questi errori sono sistemici e si verificano indipendentemente dalla lingua, dal Paese o dal tipo di IA.

https://rsi.cue.rsi.ch/info/ticino-grigioni-e-insubria/%E2%80%9CL%E2%80%99IA-ci-d%C3%A0-risposte-allineate-con-il-nostro-modo-di-vedere-il-mondo%E2%80%9D--3167259.html

Dato che, secondo l’indagine, il 15% dei giovani sotto i 25 anni si informa tramite assistenti basati su IA, questo dato è significativo. Informazioni false, fuorvianti o imprecise minano la fiducia delle persone e possono compromettere la partecipazione democratica. L’intelligenza artificiale come fonte di informazione deve migliorare, ma anche la competenza mediatica degli utenti deve essere rafforzata.

L’addestramento dell’IA

Gli assistenti basati su intelligenza artificiale, i cosiddetti grandi modelli linguistici, sono stati addestrati con enormi quantità di testi, spiega Jürg Tschirren, redattore digitale di SRF. In questo modo imparano come funziona il linguaggio umano. Tuttavia, non comprendono ciò che scrivono e non sanno distinguere tra vero e falso. L’IA calcola semplicemente quale parola è più probabile che segua quella precedente. Le affermazioni di un assistente IA sono quindi probabilità, non fatti verificati.

Questo comporta una doppia difficoltà quanto si tratta di attualità: da un lato gli eventi nuovi di solito non sono presenti nei dati di addestramento, proprio perché sono nuovi. Dall’altro, ciò che è inaspettato, ovvero ciò di cui parlano le notizie, contraddice la logica statistica di questi modelli. Finché i sistemi funzioneranno secondo questo principio, gli errori non scompariranno del tutto.

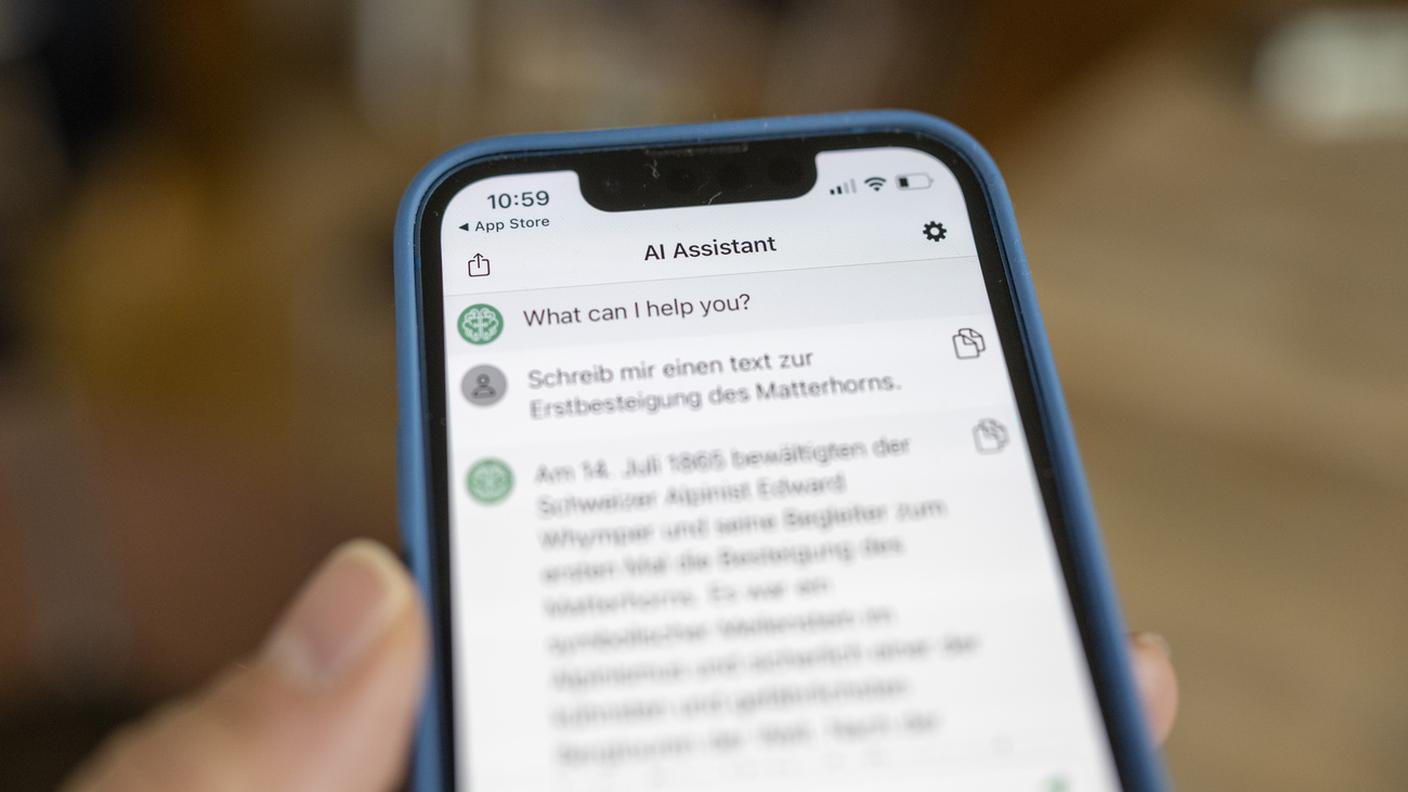

Ci si può fidare dell’IA là dove non è fondamentale che qualcosa sia esatto, ad esempio nella scrittura di testi quotidiani. In questi casi, la macchina può attingere a innumerevoli esempi e fornire risultati per lo più solidi.